Il lancio del servizio di generazione video Sora2 da parte di OpenAI, in realtà un'evoluzione del precedente Sora, avvenuto lo scorso 30 settembre ha generato parecchio movimento e discussione nel campo dei contenuti video ottenuti mediante l'uso dell'IA generativa.

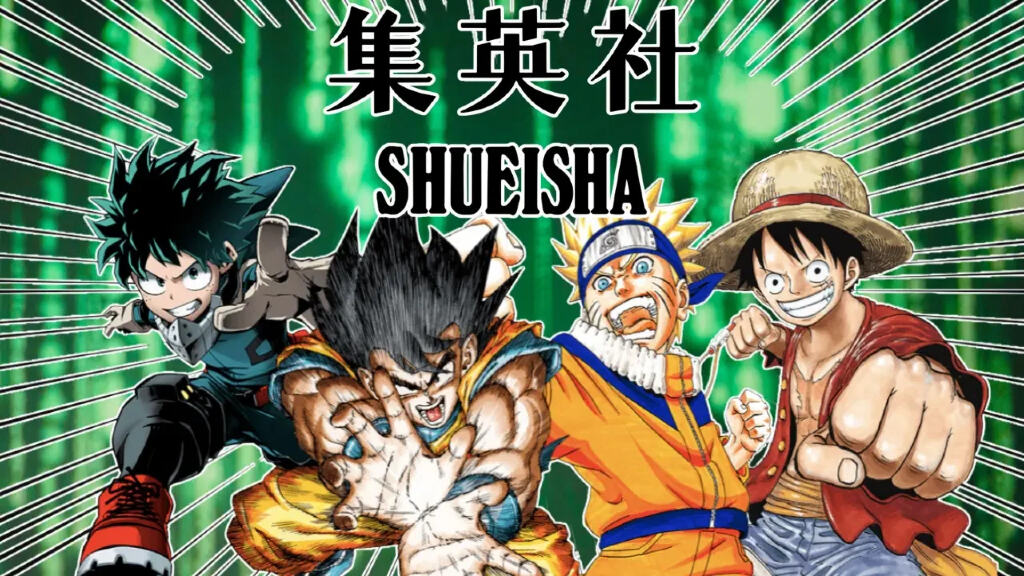

Alla già massiva mole di video ottenuti da questi strumenti si sono poi ovviamente aggiunti video in stile anime e non è difficile trovarne di vari che ospitano personaggi presi dai franchise più disparati da Dragon Ball a Super Mario, One-Punch Man e Sword Art Online solo per citarne alcuni.

La cosa ha ovviamente catturato l'attenzione dei detentori delle proprietà dei suddetti franchise, poco contenti dell'uso che ne veniva fatto dei propri contenuti.

Il 27 ottobre scorso l'associazione di editori giapponesi Japan's Content Overseas Distribution Association (CODA) ha pubblicato un comunicato in merito con richieste esplicite ad OpenAI.

"CODA ha confermato che gran parte dei contenuti prodotti da Sora 2 sono molto simili a contenuti o immagini da opere giapponesi. È stato stabilito che ciò è dovuto all'utilizzo di contenuti di proprietà giapponesi come dati nel processo di apprendimento. In casi come questi, come per Sora 2, dove vengono riprodotte, o generate in modo simile, opere tutelate, CODA ritiene che la replicazione nel processo di machine learning possa costituire una violazione del copyright.

Inoltre, secondo quanto riportato dai media, è stato affermato che Sora 2 risponde attraverso un sistema di opt-out basato sulle richieste dei titolari dei diritti d'autore. Tuttavia, in base alle leggi giapponesi sul copyright, per l'utilizzo di opere protette è generalmente richiesta un'autorizzazione preventiva e non vi sono sistemi che consenta di evitare la responsabilità per violazione attraverso successivi reclami.

Le richieste presentate da CODA al momento sono pertanto le seguenti:

- Che nell'ambito del funzionamento di Sora 2, CODA richiede che i contenuti dei propri membri non vengano utilizzati per il machine learning senza il loro permesso;

- Che OpenAI risponda in modo sincero alle richieste e alle domande delle aziende membri di CODA in merito alla violazione del diritto d'autore relativa ai contenuti generati con Sora 2.

CODA, in collaborazione con le aziende membri, richiede che OpenAI risponda in modo sincero, in modo da garantire sia il sano sviluppo della tecnologia AI, sia la protezione dei diritti dei titolari e dei creatori.

.jpg)

A seguito del lancio di Sora2, OpenAI aveva progressivamente impostato filtri e sistemi vari di Opt-out prima contro deepfake e poi anche verso l'apparizione di personaggi non originali (i cosiddetti cameo) ma appunto dietro richiesta dei detentori dei diritti per i quali questa modalità non sembra affatto sufficiente.

Nello stesso mese anche il governo giapponese aveva inviato una richiesta, al momento senza replica, ad OpenAI per chiedere la tutela di opere come manga, anime e giochi giapponese e di bloccarne l'uso per generare video. La legge giapponese però in questi caso prevede (al momento) il solo avvio di indagini.

Fonti Consultate:

CODA (comunicato ufficiale)

Anime News Network

Punto Informatico

La logica è: se io compro 50 libri e li studio è legale, quindi perché non dovrebbe esserlo se invece di leggerli io, li faccio studiare alla mia GPU?

Più nel dettaglio se qualcuno è curioso, c'è uno studio dell'università di Berkeley commissionato dal congresso degli Stati Uniti che ha studiato tutta la questione nel dettaglio, spiegando il processo di learning e i precedenti legali e ha concluso che in sostanza usare materiale sotto copyright per l'addestramento di AI è legale (negli Stati Uniti).

Eccolo: https://btlj.org/wp-content/uploads/2023/02/0003-36-4Quang.pdf

Pertanto la prima delle due richieste è una forzatura logica e legale (qualcuno più attempato si ricorda il processo che le compagnie di produzione fecero a JVC quando inventarono il VHS?). Per il resto sicuramente è corretto legalmente proteggere il diritto d'autore. Come al solito è l'uso che se ne fa il problema, non lo strumento.

Più volte sia qui che altrove ho dovuto puntualizzare su questo punto perché molti non comprendono che da strumento di "supporto" l'AI sta diventando totale sostituto, un'esempio che riguarda anche il mio campo? Grafica pubblicitaria, editoriale e 3D:

Ciò che prima richiedeva anni di pratica e di studio degli strumenti oggi molte aziende lo fanno inserendo 3-4 prompt messi in croce all'interno della generative fill di Photoshop e non solo roba rasterizzata ma si sta lavorando (sempre lato AI) per ampliare al vettoriale... e lì sarà praticamente la fine REALE del lavoro del grafico. Si perché le aziende stanno già muovendosi in tal senso, d'altra parte perché pagari 10-20 persone quando puoi pagarne un paio o nessuna facendo fare tutto all'AI? Ci sono delle sbavature quà e là? E chissenefrega tanto l'utenza media manco li guarda i dettagli!

Tornando all'articolo, il problema rimane perché qua non si parla tanto di addestramento ma di utilizzo vero e proprio dell'AI. Non solo, in molti non apprezzano l'utilizzo dell'AI nei prodotti di consumo, specie quelli più attenti ai dettagli e che notano difetti e anomalie negli shader di immagini e video. Il valore dato ad un'opera viene acquisito anche tramite la consapevolezza del lavoro che c'è dietro, se l'80% del lavoro lo fa una AI vogliamo proprio dare lo stesso valore a quell'opera? Io francamente non sono per nulla entusiasta ma naturalmente in molti potranno vederla diversamente o peggio potrebbe non importargliene affatto.

In ogni caso l'AI sta sconvolgendo, neanche troppo velatamente, il mondo del lavoro e dell'intrattenimento e lo sta facendo in maniera spaventosamente insidiosa.

Per esempio quando i generatori di video diventeranno molto più potenti (fra 5 anni avranno già fatto passi da gigante), avranno molto da preoccuparsi in Giappone.

Ma non solo loro.

Animatori, doppiatori, scrittori, ect sono in allerta per via della IA che sconvolgerà vari settori.

Hai ragione anche sul fatto che le aziende stanno riducendo il lavoro di 10/20 persone a 1/2 persone con l'IA. Purtroppo questa è la storia dell'umanità: il progresso scientifico ha sempre portato con sé una maggiore automazion, ma entriamo in una sfera più complessa in cui rientra una struttura mondiale basata sul capitalismo. E onestamente ritengo che questi sono i risultati del mondo che abbiamo costruito e a cui ancora oggi le persone aspirano anche se il massimo del capitale sono le bollette che si accumulano nei mesi...

Più prosaicamente (preso atto che il mondo è questo), personalmente ritengo che ampliare la mia conoscenza dello strumento (e della mia materia di competenza) potrebbe farmi essere tra le 1/2 persone che restano...

Eh no. Stando nel contesto, CODA chiede proprio come primo punto:

Che nell'ambito del funzionamento di Sora 2, CODA richiede che i contenuti dei propri membri non vengano utilizzati per il machine learning senza il loro permesso;

e questo è ciò che sto contestando perché non ha senso. né logico, né legale.

Le due cose non sono assolutamente comparabili. Quando una persona studia un libro lo fa, oltre che per memorizzare delle nozioni, per sviluppare un pensiero critico e una visione più ampia della realtà. Una IA non può fare niente di tutto questo. Non può sviluppare un pensiero critico, ma solo rubare idee e pensieri altrui, masticarli, mescolarli e sputarli come un boccone mal digerito. Stessa cosa con l'arte. Non c'è l'ispirazione, il vissuto, la tecnica che un artista impiega anni a sviluppare. Quello che una IA fa è memorizzare un tratto tramite una serie di immagini ed elaborarli per realizzarne di nuove, di fatto, plagiando quello che è lo stile di qualcun altro, la sua identità artistica. E questo non è legale, né dovrebbe esserlo.

E in base a quale principio una persona che studia o fa mezzo schizzo su carta è un artista? Quanti scarabocchiatori ci sono? Oppure credete che leggere 4 libri e fare 10 disegni renda tutti Van Gogh?

L'ha fatto l'UE. Risultato? Sono scappati tutti. Investimenti persi, soldi andati. Utile.

Io lo definerei anche un problema pratico. Come si fa a dimostrare che il risultato (sto parlando di generazione di personaggi "originali" e non già creati) di un'operazione matematica complessa basata su tensori ha utilizzato in maniera "illegale" materiale?

A questo aggiungo, e immagino a molti sorprenderà, che alcuni no-profit Giapponesi che hanno creato personaggi hanno lasciato data di training e hanno consentito l'utilizzo dei loro personaggi con modelli generativi.

Infatti si chiamano modelli generativi (o di linguaggio per i chatbot). Chiamarli AI è senza senso. Detto questo, generano cose che "Non esistevano" prima, per cui il luddisimo mi fa un po' ridere.

Questo è il cavillo con cui hanno fatto passare tutto, per convenienza. La logica è fallace: tu puoi studiarti 50 libri e ancora quello che elabori e ciò che produci rientra nel potenziale umano e alla singola persona. Una macchina replicabile ed espandibile non ha questi limiti e crea un problema concorrenziale ad una velocità che non permette adattamento. Non sono la stessa cosa quindi questa equiparazione non può essere usata come argomentazione.

Oggi c'è un forte conflitto di interesse per i legislatori che non ha nulla a che vedere con i diritti e le tutele: il mercato delle IA è un grosso investimento e starne fuori significa diventare meno competitivi. Se si vuole limitare devono farlo tutti altrimenti chi lo fa sarà sempre svantaggiato e ormai sono tecnologia di importanza nazionale. Questo è il motivo.

Però è un po' come dire: posso essere competitivo inquinando 10 volte tanto, se non lo faccio gli altri mi passano davanti. Quindi inquiniamo. È la stessa logica: affari e competizione prima di etica e tutele. E come dici, è il mondo che ci siamo costruiti.

Riguardo le IA e i modelli generativi, se non ci fossero dei ragionamenti di convenienza dei vari paesi, sarebbe molto semplice legiferare, o quantomeno colmare il vuoto in cui si è cavillato fino ad ora.

Se produci qualcosa in cui anche solo un dato non è di tua proprietà, tutta la base dati è viziata, tutto ciò che produci deve essere di pubblico dominio e non può essere venduto o essere la base per lucrarci.

Passo due: le tecnologie che hai sviluppato dell'IA sono rese possibili da basi di dati composte di dati rubati (ci sono innumerevoli casi confermati), quindi senza di esse non saresti mai riuscito a raggiungere questi traguardi in così poco tempo. Va indennizzato chiunque è proprietario di questi dati rubati. Inoltre, devi perdere ogni diritto su ciò che hai prodotto da questa ricerca e sviluppo, algoritmo dell'IA compreso, che non sarebbe esistito altrimenti. Riparti da capo, solo con mezzi legali.

Si può parlare di progresso se migliora la vita di solo poche persone al danno di molteplici? Quello che al momento fa è inibire progresso, sperimentazione e affinamento delle proprie capacità.

I modelli generativi sono una bella tecnologia ma sta crescendo troppo in fretta senza pagarne veramente l'investimento: quello per la maggior parte è a gratis sulle spalle di altri. Ci finiscono tanti soldi ugualmente, per la ricerca, ma una frazione rispetto a quanto richiederebbe davvero se si corrispondesse il giusto (previo comunque consenso).

A parer mio è una bellissima tecnologia ma che dovrebbe prendere una piega completamente diversa: essere un servizio per chi i dati li produce per espandere la propria produzione, non per lucrare sul lavoro di altri, come ladri legalizzati.

Per altro farei notare l'assurdo di quando le diverse società che sviluppano intelligenza artificiale si contestano a vicenda la distillazione dei dati, perché solo quando rubano a loro è un problema...

Alcuni esempi di utilizzi virtuosi: l'artista che digitalizza la propria produzione per produrre materiale per merchandise, il doppiatore che digitalizza la propria voce per poter prendere più lavori di quanto può normalmente e magari doppiandosi in lingue diverse o ad età diverse. In questo caso sarebbe un servizio offerto a produttori di contenuti, non una produzione di contenuti su dati rubati.

Anche nelle software house, tra farsi scrivere il codice dalle IA e usarla per automatizzare dei processi (esempio riconoscimento dei ticket di assistenza, estrapolazione di dati da proprie basi dati), sono due cose ben diverse.

Io spero che questo impuntarsi di CODA porti a qualcosa, prima di tutto trasparenza: i database delle IA devono essere aperti, così come gli algoritmi, anche solo per verifica.

Va dimostrato in tribunale. Altrimenti sono chiacchere.

E quale sarebbe il "giusto"? Inoltre credo che non ci si renda bene conto della complessità di calcolo di questi modelli e dei tempi di generazione ecc.

Inoltre "troppo in fretta" lo si diceva anche per la rivoluzione industriale.

Sfortunatamente per il burocrate legislatore, il mondo va molto più in fretta (in generale) di quanto lui possa sfornare regolamenti inutili. Vuoi attutire il colpo per evitare problemi che comunque ci saranno? Bene. Vuoi tentare di bloccare tutto? Fallirai e l'unica cosa che otterrai sara' un bagno di sangue, metaforicamente parlando.

Questo c'e' già da anni, diamine. Capisco che non si sappia nulla al di fuori del Giappone ma ci sono almeno 4-5 compagnie che producono software di questo tipo basati su doppiatori noti e meno noti (Coefont, CeVIO AI, Voisona, AI Voice, Vocalomarkets), per non parlare del fatto che ce ne sono pure gratuiti! (VOICEVOX, Coeiroink). Per la maggioranza da 2-3 anni ormai, sono software che utilizzano modelli basati su reti neurali anche se non sono gli ultimissimi.

Perchè la GPU non sta studiando, sta copiando, e quando a scuola invece di studiare per una verifica si copia, che succede quando si viene beccati?

Il resto della tua logica sul "potenziale umano" resta un po' nella metafisica. Come dire le persone hanno un'anima, le macchine, no? E quindi?

Allora non usare il cellulare per chiamare qualcuno, mandagli una lettera perché rientra nel potenziale umano, non prendere la macchina per andare a lavoro, ma vai a piedi perché l'uomo non è stato fatto con le ruote... e così via...

Vero, Anthropic ha piratato migliaia di libri con cui ha addestrato le IA e ha dovuto pagare per questo. Ma l'illegalità in questo caso è nell'aver usato materiale ottenuto illegalmente. Se io il libro lo compro, non c'è alcuna legge che mi impedisca di usarlo per addestrare una IA come non c'è una legge che mi impedisca di usare il libro come fermaporta. Tanto più che se il libro è divulgativo, lo scopo del libro è proprio quello di "insegnare" qualcosa. L'azione di "machine learning" da dati ottenuti legalmente, non è di per sé illegale e se lo diventasse per me sarebbe un grave episodio di limitazione della libertà personale. Certo poi se usi l'IA per distribuire materiale derivato protetto da copyright allora è diverso, ma devi punire il reato non la "possibilità di commetterlo" che non è neanche l'intenzione.

Per favore. leggiti il pdf che ho linkato nel primo commento dove spiega bene cosa sta facendo l'IA quando "impara". Quella della copia o del famoso "pappagallo stocastico" è un'argomentazione che ormai è stata confutata più volte. Quello che non fate è astrarvi dalle problematiche che "adesso" hanno le IA ma che potrebbero essere superate in futuro. Oggi l'IA sbaglia sicuramente, ma chi dice che in futuro non possa migliorarsi ulteriormente tanto da diventare indistinguibile da un qualsiasi lavoro dell'essere umano.

Forse si', ma è bene ricordare che Asimov già negli anni '50, con Abissi d'Acciaio aveva segnalato un limite insuperabile (e no, non sono le tre leggi della robotica, quelle sono un artificio letterario): un LLM o modello generativo non può andare oltre i limiti del modello stesso. E il modello non è la realtà, solo una (ottima) approssimazione.

Questo non per confutare quello che hai scritto, ma per segnalare che comunque c'e' un limite.

Premetto che ho comunque usato il condizionale, non ho la sfera di cristallo per sapere dove ci fermeremo o a quale limite ci fermeremo.

Ad ogni modo mi piace leggere (proprio in generale ho sempre detto che preferisco un buon libro ad un buon fumetto, ma ho comunque casa piena di manga, eh?) e ho letto molti libri di etica e di filosofia sull'intelligenza artificiale. Alcuni libri ponevano l'accento fortissimo su queste cose mettendo dei punti critici di problamatiche che secondo loro l'IA non sarebbe mai stata in grado di risolvere, salvo poi essere smentiti nel giro di pochi anni.

Altri più catastrofisti dicono che si arriverà ad un punto in cui l'IA sarà in grado di autoalimentarsi da sola senza bisogno dell'uomo e si arrivrà all'estinzione umana.

Secondo me è un bene informarsi e leggere tutti i punti di vista, ma è anche un bene non avere paura dello strumento, ma conoscerlo per saperlo dominare un domani. Io è semplicemente questo che mi auspico: la possibilità di essere sempre in controllo.

Che si sia uno sviluppatore, un creator o qualunque altro professionista, credo che saper usare bene l'IA servirà nel mondo del futuro anche per mantenere il lavoro. A maggior ragione se l'IA si dimostrerà avere dei limiti insormontabili: sarà proprio lì che le persone potranno intervenire con la propria conoscenza e buon senso.

Sarà un bene o un male?

Purtroppo questo problema è irrilevante, sarà il futuro, anzi probabilmente è già il presente e chi si adeguerà sarà al passo coi tempi, gli altri resteranno indietro...

Esattamente quello a cui stavo pensando.

E mi permetto di aggiungere, il fatto di avere i mezzi per superare (o almeno provare) certi limiti non significa che sia la mossa migliore.

Vogliamo davvero giocare a fare i Frankenstein nella Realtà? Benissimo, ma allora il risultato non porterà da nessuna parte ...

Forse il paragone migliore è con l'Uncanney Valley: vogliamo traslarla davvero nella quotidianità, continuando a sostenere ipocritamente che sia solo un supporto, quando già si mira a renderla il più vicina possibile perfino alle conoscenze umane?

Come quell'attrice di Hollywood interamente ricreata in IA, i cui creatori continuano a definire come una semplice "aggiunta" alle produzioni per limitare costi o simili, senza sostituire nessuno ... anche dopo aver ammesso di averla basata su caratteristiche fisiche di più attrici esistenti.

Io vi dico solo questo. C'è uno youtuber che fa video sulle nuove tecnologie, ha anche scritto 2 libri ed è ingeniere informatico, è lavora in USA proprio sotto Open IA.

In una live disse chiaramente che quello che stanno sviluppando ora dietro le quinte e che ancora non è in commercio, è 10 anni avanti ai chatgpt, generatori, ect e robe simili che attualmente possono essere utilizzati da tutti.

Quello che stanno sviluppando dietro le quinte fa sembrare quello che c'è attualmente una roba da bambini.

A me pare l'esatto contrario. La maggior parte dell'umanità non è in grado di disegnare, cantare, doppiare, animare o girare film, di sicuro non ai livelli considerati "professionali". Se invece le cose continuano così, presto letteralmente chiunque sarà in grado di farsi da solo i propri disegni, canzoni, film e quant'altro, tutto a livello di un opera tradizionale. E gli unici a rimetterci saranno i pochi privilegiati che possedevano questi talenti innati. E perché invece la maggior parte che è nata senza questi doni non dovrebbe accogliere l'opportunità di pareggiare i conti? E il tutto pure senza spendere un sacco di soldi per frequentare noiose accademie?

Non mi spaventa affatto l'idea di un futuro dove non dovrò pagare 80 dollari ad un tizio perché mi faccia una fanart su commissione. E farei i salti di gioia se esistesse un programma che basta inserirvi uno script e ti anima la scena con lo stile che preferisci. E chi si lamenta del copyright, avrebbe dovuto lamentarsi a suo tempo anche delle fanarts, delle fanfictions e delle doujinshi.

Di perdere la loro posizione privilegiata, che altro? Secondo voi perchè nel film degli Incredibili il concetto "tutti potranno essere supereroi" viene passato per cattivo e un piano diabolico? Perché non c'è niente che spaventa i privilegiati più di diventare normali. E dovremmo pure compatirli...

Che tutti dovrebbero avere il diritto di provare a realizzare qualcosa, è giustissimo ...

Ma dobbiamo proprio forzare la mano? Tu parli di privilegiati, ma a parte il fatto che non tutti questi talenti ci arrivano a veder realizzati i propri progetti pur con tutta la bravura possibile, vogliamo dare il via libera a una serie di gente che realizzerà solo risultati artificiosi, illudendosi di poter produrre una qualità non propria?

Ne GLI INCREDIBILI quella frase è motivata dalla vendetta di un eterno bambino che voleva provare a tutti i costi a fare il supereroe, e aveva pure le potenzialità sul piano inventivo ... Ma non aveva il minimo talento, non basta costruire super-tute per essere un eroe

E nella realtà, non basta saper manovrare varie tecnologie per saper costruire qualcosa di concreto, non per forza sul piano artistico

Semplice e diretto

E perché no? Dopotutto, chi stabilisce esattamente cos'è artificioso e cosa no? Tu, io, la maggioranza? Come se i giudizi non fossero soggetti a cambiamenti e influenzi. Gli animatori e disegnatori a mano dicevano che l'animazione in CGI non è arte. Oggi sono stati rimpiazzati (proprio quello che temevano e che gli spingeva a cercare di bollare la CGI come "non artistica") e qualcuno definirebbe gli animatori in CGI meno artisti di quelli che lavorano a mano? Mi sembra che la percezione popolare non sia quella.

Appunto quello che intendevo. Viene promosso il concetto che solo il talento "naturale" è buono e giusto, perché così si mantiene lo status quo che solo pochi possono essere talentuosi e privilegiati, e la maggioranza di poveri mortali è destinata a rimanere anonima e incapace. Questo è un concetto giusto invece, perché si può essere speciali solo se la maggior parte della gente non lo è. E quindi la prospettiva di vedere tutti con lo stesso potenziale e gli stessi talenti spaventa.

Piuttosto che Syndrome, preferisco immaginare me e chiunque userà questi sistemi come un futuro Iron Man o Batman entrambi nati umani e deboli ma che usano la tecnologia e il progresso scientifico per competere con i vari "fortunelli" nati coi superpoteri o acquisiti per capriccio del fato/autori.

Mi dispiace, ma no ho bisogno di leggermi 30 pagine per capire che l'IA copia, e il fatto che forse un giorno migliorerà a tal punto di essere indistinguibile da un lavoro umano, non cambia il fatto che l'IA copia

Basta guardare le opere create con l'IA per capirlo, vedi per caso un IA che può creare uno stile tuttu suo? No, è tutto copiato da quello che è stato messo su internet da artisti umani

Se un giorno l'IA si evolverà a tal punto di poter avere una propria creatività, all'ora si può avere il dibattito di se la creatività dell'IA abbia lo stesso valore di quello umano, ma fino ad all'ora, l'asciare che degli umani pigri usino l'IA per copiare allo scapito di quegli umani che lavorano sodo per le loro creazioni è sbagliato punto e basta

Per altro chi mai farà contenuto di qualità (o addirittura studierà in tal senso) se alla fine quel contenuto 1) non verrà visto perchè sommerso dagli elaborati IA 2) potrà realizzarlo con un decimo del tempo come tutti gli altri con la IA

Alla fine (e già si sta notando) non avremo più nulla di realmente creato ma solo un continuo rimpiattarsi di elaborati IA che si copieranno a vicenda... c'è chi parla di democrazia artistica per me è solo una triste distopia

La premessa del mio discorso era proprio che oggi, ma già si è tardato per volontà, non c'è legislazione chiara in merito. O meglio, per convenienza si è deciso di equiparare persone e macchine non tenendo conto della loro differenza. Era stato posto qualche limite inizialmente, poi sollevato per questioni di competitività: e di nuovo ricadiamo qui, non si è scelta la tutela, ma l'interesse di poche aziende e del giro di soldi che c'è dietro.

Il mondo va in fretta ma qui non ci si è mossi coscientemente per tempo, altrimenti si sarebbe intervenuti già da tempo.

Il paragone con la rivoluzione industriale non regge per due ragioni: il primo è che lo si cita come un caso positivo mentre i suoi aspetti negativi nel caso odierno sono addirittura amplificati. E trovo che si potrebbe imparare da questo per pensare ad un progresso sostenibile.

Il secondo è si omette completamente su cosa si basa questo progresso: non sulla ricerca e la sostituzione del lavoro umano, ma sul furto e la riproduzione senza compenso del lavoro umano. Una cosa che non sarebbe esistita con questa rapidità se l'accesso a questo dati fosse stato regolamentato.

Chiedo un prestito in banca. Non me lo concedono. Allora rapino la banca e investo tutti i soldi in borsa e divento straricco. Quei soldi li reinvesto in compagnie che mi fruttano milioni. Sbaraglio la concorrenza. Anche restituissi ciò che ho rubato alla banca, cosa che non avviene per le IA, quei guadagni sono miei? Le aziende che ho aperto e i loro guadagni sono miei? Le aziende che ho sorpassato perché loro seguono le regole e io no, devono accettare la cosa? Mi sembrano tutte domande lecite e la situazione qui è molto simile.

[/quote]

Non è la stessa cosa che ho detto io. Tu parli di un'azienda che possiede delle voci digitalizzate. Io parlo di fornire come servizio, tramite l'IA, del lavoro di apprendimento e generazione a partire dei dati del committente (voce per il doppiatore) al fine di consentire a lui di produrre i propri contenuti basati su informazioni che gli appartengono e per creare prodotti simili in suo totale controllo. Sono cose estremamente diverse.

Purtroppo la politica è imprescindibile perché è un argomento che richiede regolamentazione legislativa e può partire solo dalla polica: l'impresa questo non lo fa. E come premettevo, ci sono degli interessi che hanno fatto sì che la politica non intervenisse sul serio, per la mole degli interessi economici in gioco.

Il discorso del potenziale umano credo sia stato travisato: parlo di discorso competitivo su cui le leggi vigenti si basavano, esistevano per paragonare attività svolte da persone e non da macchine e quindi sono inadeguate oggi. O meglio, vengono forzate nell'essere considerate equivalenti quando chiaramente non lo sono.

Esattamente il problema di legislazione che dicevo. La legge è stata creata non pensando all'esistena dell'IA, ma per regolare la competizione tra persone. L'IA questo ragionamento lo scardina.

Se devo essere sincera, sto quasi vedendo l'effetto opposto, più escono prodotti creati pigramente con IA (che per di più costano più delle cose create normalmente, vedi immagine sotto), più la gente sembra rigettare il concetto e va in cerca di cose fatte col cuore

vv Calendario JJK vs calendario IA

Ma non è quello che penso io, pero'. Semplicemente pensare roba stile Terminator II e' fuori discussione. Il romanzo che ho citato, in una discussione dice proprio che modificare una parte fondamentale di un modello per fare qualcosa di "proibito" significa dover ripartire da zero. Ed è questo il punto: se la struttura di questi LLM può arrivare fino ad un certo punto, non lo può superare. E non per etica o similari, ma per come funziona la scienza e la fisica in generale.

Se la "legislazione non chiara" è l'AI act, meglio starsene senza. In ogni caso i modelli attualmente sono super castrati per motivi "morali" e non sostanziali, cosa che mi irrita non poco.

Lo fa già Coefont. C'e' un servizio apposta, per privati e commerciali. Se ne è parlato pure su questo sito quando hanno autorizzato l'uso della voce di un doppiatore passato a miglior vita (con il consenso della famiglia).

Ora, comprendo che l'isteria anti-LLM stia arrivando a livelli alti, però occorrebbe anche fare qualche giro informativo prima di dire certe cose.

Ci sarebbe molto da dire su questa frase che è pregiudiziale, ma non è il posto per farlo.

Usando il tuo esempio:

Per imparare una cosa, quei 50 libri, devo pagare gli scrittori/educatori, quindi perchè la compagnia per insegnare alla sua macchina non mi dovrebbe pagarmi per il mio "insegnamento", ergo lavoro?

Non mi sembra che tutti questi artisti, scrittori, o studios sono stati pagati per il loro insegnamento dalle compagnie. Le loro opere sono state ergo piratate e usate per le macchine, ergo in principio già illegali.

Quindi non è solo una questione di output, ma pure di input.

Ogni caso non mi sembra giusto usare il risultato con il diritto americano per il giappone e neppure per europa e in italia. Paesi diversi, leggi diverse.

L'unica cosa che si evince dalla tua risposta è una quantità francamente malsana di invidia. Definire privilegiati persone che hanno preso una passione, e con dedizione e sacrificio hanno impiegato anni per coltivare, affinare e padroneggiare, è, francamente, l'apoteosi della follia, del fanatismo e dell'egocentrismo più estremo. Oltre a dimostrare il disprezzo più totale nei confronti di coloro che svolgono un lavoro artistico e che, a detta tua, non meritano di essere pagati per il loro tempo e la loro arte. Il tutto solo perché TU non sei in grado, o non ti puoi permettere di pagare un artista. Che dire, grazie per aver dimostrato ancora una volta e tanto chiaramente quanto ci sia di malato dietro a tutto questo.

Quello che scrivi è molto confuso. Se i libri sono stati piratati, ovviamente il reato è quello di aver priratato i libri. Ma non è quello che ho detto. Nell'ipotesi in cui tu abbia regolarmente pagato i libri e quindi compensato già gli scrittori, che li legga tu o li legga la tua macchina non fa differenza né logica né legale.

A parte che non ci sono ancora leggi in proposito né in Giappone, né in Europa. L'addestramento avviene negli Stati Uniti, per cui come potrebbe (anche in assenza di trattati) il Giappone perseguire un presunto reato in un paese in cui il fatto non è reato?

E no, non sono contro il progresso, sono contro uno strumento usato da cani e porci che braserà milioni di posti di lavoro e abbasserà la qualità dei prodotti che fruiamo tutti i giorni (non solo in campo creativo, ma anche nel campo della scrittura e del giornalismo), il tutto per arricchire i CEO delle varie aziende che sviluppano questi strumenti.

Il progresso è utile se serve alla popolazione, ma se la danneggia non è più progresso.

Che poi se perdiamo tutti il lavoro chi manderà avanti l'economia?

Va fermata e limitata, in Giappone fanno bene a tutelarsi, in Europa non l'hanno ancora capito che a breve ci troveremo tutti con le chiappe per terra.

Devi eseguire l'accesso per lasciare un commento.