Negli ultimi anni, la caccia al fotorealismo nei videogiochi sta diventando sempre più accanita. Nonostante titoli come Hellblade II o le produzioni di Remedy (Control, Alan Wake II) abbiano già raggiunto livelli di qualità eccezionali e il futuro ci riservi produzioni di alto livello in tal senso (come, ad esempio, The Witcher IV), l'industria non sembra volersi accontentare.

Nvidia, la software house produttrice di schede video, si è sempre schierata in prima linea in questo campo, grazie all'utilizzo delle sue tecnologie generative: DLSS, Frame Generation e Ray-Tracing (e la sua più recente versione, il Path Tracing). Soprattutto la prima, il DLSS, viene costantemente aggiornata per garantire agli utenti un'esperienza fluida e con grande fedeltà visiva; nell'ambito di questa sfida la compagnia ha presentato nella giornata di ieri la versione 5 della tecnologia, con risultati che hanno lasciato tanto a bocca aperta quanto divisa l'utenza.

Nvidia, la software house produttrice di schede video, si è sempre schierata in prima linea in questo campo, grazie all'utilizzo delle sue tecnologie generative: DLSS, Frame Generation e Ray-Tracing (e la sua più recente versione, il Path Tracing). Soprattutto la prima, il DLSS, viene costantemente aggiornata per garantire agli utenti un'esperienza fluida e con grande fedeltà visiva; nell'ambito di questa sfida la compagnia ha presentato nella giornata di ieri la versione 5 della tecnologia, con risultati che hanno lasciato tanto a bocca aperta quanto divisa l'utenza.

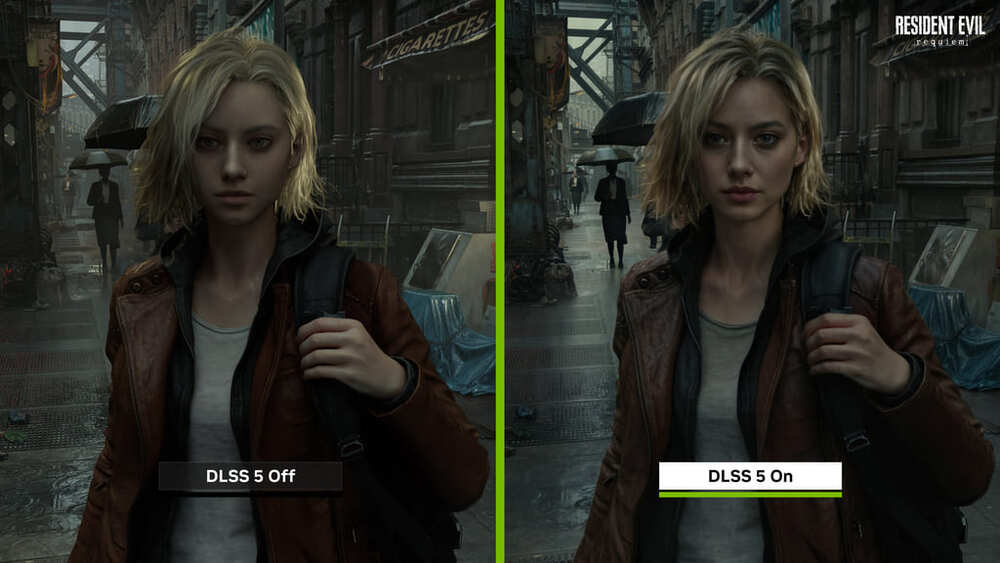

Nell'annuncio sul suo blog, Nvidia ha infatti dichiarato che la prossima versione del DLSS sarà potenziata dall'IA, permettendo un miglioramento dell'immagine tale da renderlo indistinguibile dalla realtà. In tal senso è stato mostrato un filmato dei primi minuti di gioco di Resident Evil: Requiem, nel quale possiamo vedere la tecnologia trasformare i volti di Grace e Leon in versioni che definire fotorealistiche sarebbe riduttivo.

Nello specifico, è stato spiegato che questa versione funziona in maniera tale che l'IA utilizzi come base la palette cromatica e i vettori di movimento di ogni punto sullo schermo, per poi infondere la scena con illuminazione e materiali fotorealistici, ma comunque ancorati alla scena 3D (e dunque renderizzati in tempo reale). Questo modello di IA è addestrato per capire schematiche complesse come i capelli, tessuti, volti e illuminazione della pelle, oltre alla differenza tra i tipi di luce presenti nello scenario.

Diverse sono state le software house che hanno deciso di collaborare fin da subito con Nvidia per testare la tecnologia sui loro giochi, nello specifico troveremo:

- Bethesda (Starfield e The Elder Scrolls IV: Oblivion Remastered),

- Ubisoft (Assassin's Creed Shadows),

- Warner Bros. (Hogwarts Legacy),

- Hotta Studio (Neverness to Everness),

- NetEase (Where Winds Meet, Naraka Bladepoint e Sea of Remnants),

- Capcom (Resident Evil: Requiem),

- EA (EA Sports FC),

- S-Game (Phantom Blade Zero),

- Tencent (Delta Force).

Sul blog è inoltre possibile trovare anche diversi screenshot comparativi di Starfield, Hogwarts Legacy, EA Sports FC e la tech demo Zorah.

Questa versione del DLSS arriverà in autunno, con altri publisher che si uniranno nel tempo.

E voi? Cosa ne pensate?

In un'epoca in cui si demonizza sempre di più l'uso dell'IA, può questo esserne un uso intelligente? Fatecelo sapere nei commenti!

Fonti consultate:

Blog ufficiale Nvidia

Messaggio sponsorizzato:

Vi ricordiamo che su Instant Gaming potete recuperare in sconto Resident Evil Requiem e molti altri dei titoli citati.

Vi ricordiamo che su Instant Gaming potete recuperare in sconto Resident Evil Requiem e molti altri dei titoli citati.

I collegamenti ad Amazon fanno parte di un programma di affiliazione: se effettui un acquisto o un ordine attraverso questi collegamenti, il nostro sito potrebbe ricevere una commissione.

Ora ogni nuova tecnologia arriva con polemiche più o meno grandi (e più o meno giustificate), ma qui i presupposti sono proprio negativi, poiché bisogna mettere in conto anche il consumo di energia e risorse che serve a questo tipo di strumenti (e siamo già in crisi sia per componenti che per energia). Tutto questo per ottenere una Grace che sembra una bambola di Instagram, ne vale la pena? L'uso dell' IA andrebbe limitato solo all'upscaling.

Ma adesso, come era naturale, sta diventando qualcosa che sostituisce e rifà le immagini, appiattendole, standardizzandole e omologandole nella solita plastica a cui l'AI generativa ci ha abituato. Sembra quello che un'AI restituisce quando si chiede "fammi un immagine di Grace fotorealistica" perché è esattamente ciò che è.

Come tutte le immagini generate dall'AI, fa schifo, ma non è solo la bruttezza sua il problema, è anche il fatto che va a snaturare il lavoro originale degli artisti. La faccia di Grace è proprio diversa, il naso, gli occhi, gli zigomi, soprattutto le labbra non sono neanche parenti.

Prepariamoci perché il prossimo passo di NVIDIA sarà dire agli sviluppatori di fare solo modelli semplici di bassa qualità così che l'AI li sistemi e faccia il tutto il lavoro. E cercheranno di promuoverlo come la salvezza dello sviluppo, come qualcosa che permette a tutti di fare un lavoro "ottimo" in poco tempo e con poche risorse.

Per chiunque pensi ancora che l'arte abbia qualche valore, è assolutamente imperativo respingere e rifiutare questo cosiddetto "progresso", qui e ora.

Io ancora oggi non ho ancora capito perchè buttare miliardi per questa roba, che sta portando solo ad una perdita di originalità, e mandando a casa parecchie persone capaci, per avere cosa? Annullare completamente lo stile di un gioco e la sua identità a favore di questo "Slop"aggio.

Spero che quest'incubo finisca e che prima o poi tutto ciò li danneggi a mo di boomerang.

Da 3D graphic designer questa è la consegna della lapide! Un'immagine TOTALMENTE stravolta, il viso dei personaggi sembra quella roba presa sui siti di generative images, dove tutto è contrastato, piatto, netto e senza sfumature o senso artistico.

Cosi facendo manderanno a casa quei pochi rimasti a lavorare in questo campo, quelli che per anni si sono fatti il mazzo quadrato per imparare i software, l'anatomia umana, l'illuminazione cinematografica, le inquadrature, il focus... tutto buttato nel cestino e tutto per far macinare triliardi su cose assolutamente inutili.

Se utilizzassero questa tecnologia per scopi medici o comunque realmente utili alle persone saremmo già nel futuro e invece siamo sempre più in declino, bello schifo, bravi tutti...

Sui volti poco da dire, male male anche perchè sostituisce il design originale e non in meglio. Sugli sfondi e l'ambient già diverso ma anche lì a volte si e a volte no.

C'è da dire che chi sviluppa potrà applicare la cosa in modo selettivo (sembra) per cui magari ci sarà qualcuno cum grano salis.

Ma poi quanta potenza serve per far girare tutto ciò?

"In modo selettivo"... ora... tu, lavoratore (o peggio ancora AZIENDA) puoi scegliere di lavorare a metà o lasciare il 90% del lavoro alla AI, cosa scegli? E per cortesia non tiriamo fuori cavolate perché sappiamo tutti benissimo la risposta.

Che poi "cum grano salis" nel mondo del lavoro dove già volano licenziamenti a destra e a manca ovunque vi sia la possibilità di mettere una AI che fa il lavoro al posto di gente che ha bisogno di campare? Sul serio?

"Ah no ma io la utilizzo solo per una parte poi il resto lo faccio manualmente perché ci tengo a ciò che faccio"... seeeeeeeee già me li vedo sti commenti.

Quanta potenza? A quanto pare per quel giochino il DLSS si ciuccia la potenza piena di due RTX 5090, fai tu i conti poi sui consumi elettrici e sul resto della configurazione necessaria a far funzionare na roba del genere.

Poi oh, che il risultato mostrato non sia per niente adeguato è semplicemente evidente e anche sul resto magari sono anche d'accordo.

E sulla potenza era una domanda retorica ahimè

Personalmente non capisco questa critica, come deve essere un gioco lo decide lo sviluppatore, non il pubblico... e lo sviluppatore può decidere o meno di utilizzare questi strumenti, quindi se vogliono far uscire un gioco "brutto" basta che lo facciano uscire, se vogliono far uscire un gioco bello senza IA lo fanno uscire senza IA, e se vogliono far uscire un gioco con IA lo fanno uscire con IA

il fotorealismo (anche se ste IA ancora non ci sono arrivate), è la ricerca della realtà, di conseguenza è normale che si vada verso una standardizzazione degli elementi in scena, perché più saranno simili alla realtà più inizieranno ad essere simile fra loro, è normale... poi anche qui, sta agli sviluppatori decidere di usare o non usare questi strumenti, se vogliono allontanarsi dall'ia o addirittura vogliono sviluppare nuovi modelli loro stessi son liberi di farlo

Ironico il modo in cui l'hanno publicizzato poi, neanche un accenno a un possibile miglioramento del modello di upscaling del DLSS o del FG, solo un filtro che sminchia la direzione artistica e "raga questo è il DLSS 5", fine, che scempio.

Devi eseguire l'accesso per lasciare un commento.